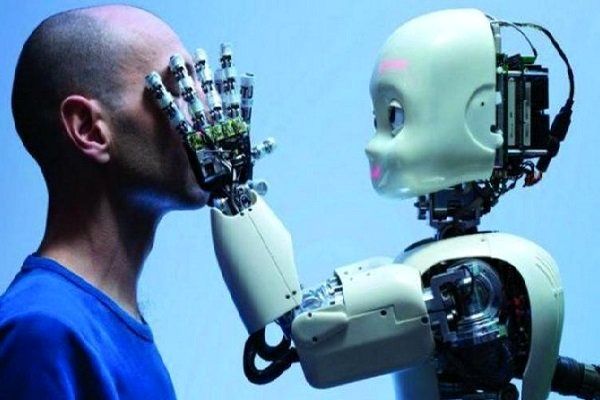

تاثیر ربات بر احساسات انسان

به گزارش اقتصاد نیوز و به نقل از ایسنا ، پژوهش جدیدی نشان میدهد که انسانها در صورت داشتن تعامل با رباتهایی که دارای هوش اجتماعی هستند، احساس گناه میکنند و این به آن معناست که ابزار رباتیک و شکلهای دیگر هوش مصنوعی، میتوانند به طور گسترده احساسات ما را درک کنند.

در این پژوهش، از ۸۹ شرکتکننده خواسته شد که ربات شبه انسان شرکت ژاپنی "سافتبانک رباتیکز" (SoftBank Robotics) موسوم به "نائو" (Nao) را پس از داشتن برخی تعاملات پایهای با آن، خاموش کنند.

هنگامی که داوطلبان تصمیم گرفتند نائو را خاموش کنند، او برای خاموش نشدن اصرار کرد و به ۴۳ نفر از شرکت کنندگان گفت که از تاریکی میترسد. با شنیدن این درخواست، ۳۰ نفر از داوطلبان پس از صرف زمان بیشتری نائو را خاموش کردند و ۱۳ نفر به خاموش کردن آن تمایلی نداشتند.

داوطلبانی که رفتار ماشینی نائو را دیده و پرسشهای عملکردی او را شنیده بودند، بدون هیچ مشکلی آن را خاموش کردند زیرا به نظر آنها، نائو مانند یک لپتاپ، تنها یک ابزار الکتریکی بود.

در چکیده مقاله این پژوهش آمده است: نتایج نشان میدهند که با اعتراض ربات، شرکتکنندگان به او اجازه میدهند روشن بماند اما پس از داشتن تعامل عملکردی، ربات را به عنوان موجودی که زیاد دوستداشتنی نیست، ارزیابی میکنند و به این ترتیب، استرس آنها پس از خاموش کردن ربات کاهش پیدا میکند.

علاوه بر این، هنگامی که شرکتکنندگان، تعامل عملکردی با یک ربات معترض را تجربه میکنند، بیشتر مردد میشوند. شاید این نتیجه غیرمنتظره، ناشی از این واقعیت باشد که احساس شکلگرفته شرکتکنندگان براساس رفتار ربات، با طبیعت احساسی این اعتراض در تضاد است.

براساس گزارش این بررسی، بسیاری از شرکتکنندگان از رفتار نائو تعجب کرده و نگران بودند که کار خطایی انجام دهند. همچنین، آنها کنجکاو بودند که آیا ربات، تعامل با آنان را ادامه خواهد داد. تعداد زیادی از شرکتکنندگان، با این ربات شبه انسان همدردی میکردند و تمایلی به مخالفت با آن نداشتند.

اگرچه انسانها، معمولا برای موجودات زنده همدردی میکنند اما افزایش رباتهای شبه انسان به این معناست که انگیزه انسانها برای خلق روابط، قابل سوءاستفاده است. طراحان ربات از ما میخواهند که از تعامل با موجوداتی که ساختهاند، لذت ببریم و این کار به معنای سو بردن از ضعف ما در برابر این رباتهاست.

یافتههای این پژوهش، در مجله علمی " PLOS One" به چاپ رسید.

ارسال نظر